I. Introducción

En la actualidad, la política y la tecnología han convergido de manera inextricable, y la Inteligencia Artificial (IA) se ha erigido como un catalizador fundamental en este proceso. La capacidad de la IA para procesar y analizar grandes volúmenes de datos ha abierto nuevos horizontes en la gestión y estrategia políticas, pero también ha introducido una serie de desafíos éticos y legales significativos.

Recientemente, un incidente en New Hampshire, Estados Unidos, ha resaltado la potencial amenaza que la IA representa para la integridad de los procesos electorales. Según un reporte de Samuel Osborne para Sky News, fechado el 23 de enero de 2024, se investiga el uso de una llamada robótica que, empleando IA para imitar la voz del presidente Joe Biden, instaba a los votantes a abstenerse en las elecciones primarias (1) . Este episodio no es un caso aislado; se suma a una serie de eventos en los que la IA se ha utilizado para difundir desinformación y manipular la opinión pública.

La proliferación de tecnologías generativas de IA, capaces de crear textos, fotos y videos en respuesta a indicaciones específicas, ha generado tanto entusiasmo por su potencial como temores sobre su capacidad para hacer obsoletos ciertos empleos y para interferir en elecciones. Este incidente subraya la necesidad de abordar con urgencia las implicancias legales y éticas del uso de IA en el ámbito político.

Como señala Zachary B. Wolf en un análisis para CNN, el uso de deepfakes (2) en la política estadounidense es una realidad inminente (3) . La manipulación de información mediante IA no solo representa un desafío para la seguridad electoral, sino que también plantea preguntas fundamentales sobre la autonomía de la información, la privacidad y la libertad de expresión.

En este contexto, el presente artículo tiene como objetivo explorar las diversas facetas de la interacción entre la IA y la política, evaluando tanto sus beneficios potenciales como sus riesgos inherentes. Además, se examinará el marco legal actual y las posibles vías para una regulación efectiva que equilibre la innovación tecnológica con la protección de los valores democráticos fundamentales. Es crucial, por tanto, reflexionar sobre cómo la IA está redefiniendo el paisaje político y cuáles son las medidas necesarias para asegurar que su integración se realice de manera ética y legalmente responsable.

II. IA en las campañas electorales: oportunidades y riesgos

El uso de la IA en la política está marcando un antes y un después. Ahora, con esta tecnología, los políticos pueden hablarle a la gente de una forma mucho más directa y personal. Imagínate, mediante el análisis de toneladas de datos que se recogen de todos lados, como las redes sociales, las respuestas que la gente da en las encuestas, y hasta de los registros de quién ha votado y quién no, los algoritmos de IA son capaces de descifrar lo que realmente preocupa o interesa a los votantes. Esto es un juego cambiante porque permite que las campañas políticas se diseñen para conectar de verdad con lo que la gente siente y necesita, haciendo que el mensaje de cada político llegue de una manera mucho más cercana y efectiva

La IA posibilita un análisis sofisticado de sentimientos y opiniones en tiempo real, lo que proporciona a los partidos políticos y candidatos una comprensión más precisa y dinámica del panorama electoral

Además, la IA posibilita un análisis sofisticado de sentimientos y opiniones en tiempo real, lo que proporciona a los partidos políticos y candidatos una comprensión más precisa y dinámica del panorama electoral. Este nivel de análisis puede ser crucial para ajustar tácticas y mensajes a lo largo de una campaña, permitiendo una respuesta ágil a los cambios en la opinión pública.

En el ámbito de la movilización, la IA puede desempeñar un papel clave en la identificación de posibles simpatizantes y en la optimización de esfuerzos para incentivar la participación electoral. Mediante el uso de técnicas de aprendizaje automático (4) , es posible prever qué electores tienen más probabilidades de responder positivamente a determinadas iniciativas de participación, desde voluntariado hasta la votación misma. El primer paso en este proceso es la recopilación de grandes cantidades de datos sobre los electores. Estos datos pueden incluir información demográfica, registros de votaciones anteriores, interacciones en redes sociales, respuestas a encuestas, patrones de consumo, entre otras. Los datos recolectados se alimentan a algoritmos de aprendizaje automático. Estos algoritmos son capaces de identificar patrones, correlaciones y tendencias en los datos. Por ejemplo, pueden determinar qué características (como la edad, ubicación, interacciones en redes sociales, entre otras) son comunes entre aquellos que han participado activamente en campañas anteriores o han mostrado simpatía por ciertas causas. Utilizando los patrones identificados, la IA puede predecir qué individuos tienen mayor probabilidad de responder positivamente a iniciativas específicas de movilización. Esto permite a los partidos y candidatos segmentar eficientemente su audiencia y dirigir sus recursos de manera más efectiva. Por ejemplo, podrían identificar a los individuos que, basándose en su perfil de datos, tienen más probabilidades de votar si se les contacta personalmente o a través de ciertos canales digitales. Con esta información, se pueden personalizar los mensajes y las estrategias de contacto para resonar de manera más efectiva con diferentes segmentos del electorado. Por ejemplo, a un grupo de votantes jóvenes y tecnológicamente adeptos se les podría contactar con mensajes a través de plataformas de redes sociales, mientras que a un grupo de edad avanzada se les podría contactar mediante llamadas telefónicas o visitas domiciliarias. Los algoritmos de aprendizaje automático no solo realizan estas tareas una vez, sino que continúan aprendiendo y ajustándose basándose en la retroalimentación y los nuevos datos. Esto significa que las estrategias de movilización pueden ser constantemente refinadas para mejorar la eficacia.

Sin embargo, el poder de la IA en la personalización de mensajes políticos no está exento de serios riesgos y desafíos. El principal de ellos es la potencial manipulación y desinformación. Los bots y otras herramientas automatizadas, cuando se utilizan de manera inescrupulosa, pueden difundir información falsa o engañosa a gran escala, distorsionando el debate público y la percepción de los electores. Esto no solo plantea preocupaciones éticas, sino que también amenaza la integridad del proceso democrático.

La microsegmentación (5) , que permite dirigirse a grupos muy específicos de votantes, puede conducir a una fragmentación del discurso público. Esta práctica puede crear burbujas de filtro (6) , donde los electores solo reciben información que refuerza sus creencias preexistentes, limitando la exposición a puntos de vista diversos y debilitando el debate democrático integral. Desde una perspectiva jurídica y democrática, estas prácticas presentan desafíos significativos. La microsegmentación y las burbujas de filtro pueden conducir a una polarización creciente y a un debilitamiento del discurso democrático, ya que los ciudadanos se ven menos expuestos a un rango diverso de perspectivas y más inclinados a formar opiniones basadas en información parcial o sesgada. Esto puede socavar los principios fundamentales de la democracia, que se basa en el debate informado, la deliberación y la consideración de una variedad de perspectivas y opiniones. En este contexto, es esencial reflexionar sobre cómo las nuevas tecnologías y estrategias de comunicación política pueden ser reguladas o utilizadas de manera responsable para preservar y fomentar un discurso público saludable y diverso.

Otra preocupación relevante es la protección de datos. La recolección y análisis de información personal para fines políticos deben realizarse dentro de los límites establecidos por la legislación de protección de datos, como el RGPD en la Unión Europea.

III. Impacto en la toma de decisiones políticas: el caso Cambridge Analytica

Estas herramientas de IA posibilitan una aproximación más objetiva y basada en datos para la formulación de políticas, permitiendo a los legisladores y administradores públicos evaluar diversas opciones de política con una comprensión más clara de sus posibles efectos y repercusiones. En el ámbito de la gestión de crisis, por ejemplo, los sistemas de IA pueden ofrecer proyecciones y escenarios en tiempo real que son esenciales para una respuesta rápida y efectiva.

Sin embargo, la dependencia de la IA en la toma de decisiones políticas no está exenta de desafíos significativos. Uno de los problemas más críticos es el riesgo de sesgo algorítmico. Dado que los algoritmos de IA se entrenan con datos históricos, estos pueden perpetuar e incluso amplificar prejuicios y discriminaciones existentes. Por ejemplo, si un conjunto de datos contiene desigualdades históricas, la IA podría tomar decisiones que favorezcan inadvertidamente a ciertos grupos en detrimento de otros.

Además, la complejidad y la naturaleza a menudo opaca de los algoritmos de IA pueden reducir la transparencia en el proceso de toma de decisiones. Cuando las decisiones políticas se basan en recomendaciones generadas por sistemas de IA, puede ser difícil para los responsables políticos y el público en general entender cómo se llegó a esas conclusiones. Esto plantea preocupaciones significativas sobre la rendición de cuentas y la gobernanza democrática.

Otro aspecto preocupante es la dependencia excesiva de la IA, que podría llevar a una menor implicación humana en la toma de decisiones. Esta hiperdependencia en sistemas automáticos puede conducir a una falta de flexibilidad y creatividad en la solución de problemas complejos, donde el juicio humano y la comprensión contextual son indispensables.

En el contexto de las elecciones presidenciales de 2016 en EE. UU., el senador Ted Cruz destacó por contratar los servicios de Cambridge Analytica, una empresa de consultoría política y análisis de datos, desempeñó un papel notable en varias campañas electorales, incluidas las elecciones presidenciales de Estados Unidos en 2016. Su funcionamiento se centró en el análisis de grandes cantidades de datos para crear perfiles psicográficos de votantes y dirigir campañas de microsegmentación altamente personalizadas. Funcionaba de la siguiente manera:

- • Recolección de datos: Cambridge Analytica recopiló una vasta cantidad de datos de usuarios de Facebook y otras fuentes. Esto incluía información personal, como gustos, intereses, interacciones en redes sociales y, en algunos casos, información más detallada sobre sus comportamientos y preferencias.

- • Creación de perfiles psicográficos: utilizando estos datos, Cambridge Analytica creó perfiles psicográficos de los usuarios. Estos perfiles buscaban entender la personalidad de los votantes, sus motivaciones y sus posibles comportamientos. La idea era utilizar esta información para predecir y, en última instancia, influir en sus decisiones de voto.

- • Microsegmentación y publicidad dirigida: con base en estos perfiles, se desarrollaron estrategias de microsegmentación para dirigir mensajes políticos personalizados. Esto significaba que diferentes votantes recibían mensajes adaptados específicamente a sus perfiles psicológicos, creencias y preocupaciones.

- • Manipulación de la opinión pública: la información recopilada y analizada se utilizó para diseñar y distribuir contenido que pudiera influir en la opinión pública. Esto incluía anuncios políticos en redes sociales, noticias y otros tipos de contenido que se creía que resonarían con los votantes específicos, buscando modificar sus percepciones y, eventualmente, sus decisiones de voto.

- • Estrategias de disuasión de votos: Además de promover a candidatos específicos, también se informó que Cambridge Analytica participó en estrategias diseñadas para disuadir a ciertos grupos de votantes de participar en el proceso electoral, reduciendo así el apoyo a los candidatos oponentes.

La revelación de sus prácticas puso en el centro del debate público la importancia de la regulación de la recopilación y uso de datos personales y el impacto de las redes sociales y la analítica de datos en la política.

(Elaboración propia)

IV. Desafíos éticos y democráticos

Uno de los dilemas éticos más palpables en el uso de la IA en el ámbito político radica en la privacidad y el consentimiento. La recolección y análisis de datos personales, esenciales para alimentar los algoritmos de IA, plantean serias preguntas sobre los límites de la vigilancia aceptable en una sociedad democrática. Existe una paradoja inherente: mientras más precisa y efectiva es la IA en el análisis de datos para beneficio político, mayor es la intrusión en la privacidad individual. Esta situación crea una tensión entre el derecho a la privacidad de los ciudadanos y la eficacia de las estrategias políticas basadas en datos.

La cuestión de la justicia en el uso de la IA en la política es igualmente compleja. Los algoritmos pueden perpetuar y amplificar desigualdades preexistentes, conduciendo a una distribución desequilibrada de recursos y atención política. Esto se convierte en una encrucijada ética: ¿cómo se pueden emplear estas herramientas avanzadas sin exacerbar las divisiones sociales y económicas? La respuesta a esta pregunta exige un enfoque multidisciplinario que combine la tecnología, la ética y la política pública para garantizar que la IA se utilice de manera que promueva la equidad y la inclusión.

El riesgo de utilizar la IA para desinformar y manipular en los procesos electorales representa una de las amenazas más inminentes a la integridad democrática

El riesgo de utilizar la IA para desinformar y manipular en los procesos electorales representa una de las amenazas más inminentes a la integridad democrática. La habilidad de la IA para generar contenido falso, pero convincente (como los deepfakes), y su uso en la microsegmentación para difundir propaganda política, pone de manifiesto una paradoja democrática: la misma tecnología que tiene el potencial de informar y empoderar a los electores puede ser utilizada para engañarlos y manipularlos. Este uso indebido de la IA puede socavar la confianza en las instituciones democráticas y distorsionar el proceso electoral, creando un espejismo de consenso o apoyo que no refleja la realidad.

Las reglas y criterios internacionales de derechos humanos contienen dos grandes bloques de criterios relacionados con las elecciones democráticas: uno relacionado con elecciones libres y otro relacionado con unas elecciones auténticas.

1. Elecciones libres

Para que unas elecciones sean verdaderamente libres, es necesario que los derechos humanos sean respetados y disfrutados por todos, en particular en lo relativo a la no discriminación e igualdad de acceso a la participación (7) , la libertad de opinión y de expresión (8) , la libertad de reunión pacífica (9) , la libertad de asociación (10) , libertad de circulación (11) , derecho a la seguridad y a no ser objeto de intimidación (12) , el derecho a un juicio imparcial y a un recurso efectivo (13) ,

- 1. La esencia de las elecciones libres: la voluntad del pueblo. La IA puede ser utilizada para analizar grandes volúmenes de datos y predecir tendencias electorales, lo que podría influir en la opinión pública. Sin embargo, existe el riesgo de que dichos análisis sean manipulados para alterar la percepción de la voluntad popular, socavando la esencia de las elecciones libres.

- 2. Derechos habilitantes. La IA puede facilitar el acceso a la información y a los procesos electorales, mejorando la accesibilidad para personas con discapacidad a través de tecnologías. No obstante, debe garantizarse que la IA no cree barreras discriminatorias, como algoritmos que excluyan a ciertos grupos de la participación electoral.

- 3. Grupos sociales específicos y medidas especiales. La IA puede ayudar en la identificación de necesidades específicas de ciertos grupos sociales y en la implementación de medidas especiales para asegurar su participación electoral. Por ejemplo, programas de IA adaptativos podrían mejorar la accesibilidad para votantes con discapacidades.

- 4. Estados de emergencia. Durante estados de emergencia, la IA podría ser clave en la gestión de elecciones, facilitando procesos como votaciones en línea o el conteo automatizado de votos. Sin embargo, debe vigilarse que la IA no sea utilizada para justificar restricciones indebidas a los derechos electorales.

2. Elecciones auténticas

- 1. Periodicidad y plazos electorales. La IA puede optimizar la organización y logística de las elecciones, asegurando que se respeten los plazos electorales establecidos. Pero es crucial que la IA no sea manipulada para alterar los tiempos electorales en beneficio de determinados actores políticos.

- 2. Sufragio universal e igualitario. La IA puede contribuir a garantizar un sufragio universal e igualitario mediante sistemas de verificación de identidad más eficientes y seguros. Sin embargo, debe evitarse que dichos sistemas excluyan indebidamente a votantes elegibles.

- 3. Voto secreto. La IA puede reforzar la seguridad y confidencialidad del voto. Por ejemplo, mediante sistemas de cifrado avanzado. No obstante, es esencial que estos sistemas sean totalmente seguros para prevenir cualquier violación de la confidencialidad del voto.

- 4. Efecto de autenticidad. La IA puede ser utilizada para detectar y prevenir fraudes electorales, como la duplicación de votos o manipulaciones en el conteo. Sin embargo, la transparencia y la regulación de estos sistemas son fundamentales para mantener la confianza en el proceso electoral.

- 5. Opción verdadera. La IA tiene el potencial de influir en la formación de una opinión pública genuina y diversa a través de plataformas de información y debate. Sin embargo, debe vigilarse que no se promueva la desinformación o la manipulación de opiniones a través de algoritmos sesgados.

- 6. Opción informada. Una opción informada, que supone que todos tienen derecho a buscar y recibir información, es esencial para el concepto de opción «libre». Para que las elecciones sean auténticas, deben reflejar la voluntad política del pueblo. Mediante el acceso a la información sobre las personas candidatas y los programas que proponen, los partidos y el proceso electoral, los votantes están en condiciones de formular y expresar libremente su voluntad (14) . La IA puede ser una herramienta poderosa para proporcionar información electoral relevante y accesible a los votantes. No obstante, es crucial garantizar la objetividad de la información presentada y evitar el uso de IA para difundir información falsa o sesgada.

Para abordar estos desafíos, es imprescindible adoptar un enfoque multidisciplinario que involucre a expertos en tecnología, ética, derecho y ciencias políticas. Este enfoque colaborativo puede proporcionar una comprensión más holística de cómo la IA afecta a la democracia y ayudar a desarrollar estrategias para mitigar sus riesgos. Además, es crucial involucrar al público en estas discusiones, fomentando una comprensión más amplia de cómo la IA influye en la política y promoviendo una ciudadanía informada y crítica.

V. Marco regulatorio a nivel internacional

En el plano internacional, la regulación del derecho de voto se ha configurado como un elemento esencial en la consolidación de regímenes democráticos. Las normas y principios universales relativos a las elecciones y la participación política se encuentran plasmados en diversos instrumentos jurídicos internacionales, que han delineado un marco normativo común, orientado a garantizar el ejercicio efectivo de los derechos políticos de los ciudadanos en el escenario global.

La Declaración Universal de Derechos Humanos (LA LEY 22/1948) (1948) establece, en su artículo 21, los pilares básicos del derecho de participación política. Se reconoce el derecho de toda persona a participar en el gobierno de su país, ya sea directamente o por medio de representantes libremente escogidos, en condiciones de igualdad y bajo una voluntad popular que debe ser expresada en elecciones auténticas, periódicas, por sufragio universal e igual y mediante voto secreto o procedimientos equivalentes.

El Pacto Internacional de Derechos Civiles y Políticos (LA LEY 129/1966) (1966), en su artículo 25, amplía y especifica los derechos consagrados en la Declaración Universal, al establecer no solo el derecho a participar en la dirección de los asuntos públicos y a acceder a funciones públicas en condiciones de igualdad, sino también al votar y ser elegidos en elecciones periódicas, auténticas y por sufragio universal y secreto.

Las sucesivas resoluciones adoptadas por este organismo internacional, como la relativa al fortalecimiento de la eficacia del principio de celebración de elecciones auténticas y periódicas, refuerzan el marco normativo existente y su aplicación efectiva en el ámbito internacional.

El Convenio Europeo para la Protección de los Derechos Humanos y de las Libertades Fundamentales (LA LEY 16/1950) (1950), junto con su Protocolo No 1, establece compromisos claros para los Estados Partes en la organización de elecciones libres, con escrutinio secreto y en intervalos razonables, garantizando así la libre expresión de la opinión del pueblo en la elección del cuerpo legislativo.

La interpretación y aplicación de estos derechos en el ámbito europeo ha sido enriquecida y ampliada por la jurisprudencia del Tribunal Europeo de Derechos Humanos. Casos como Mathieu-Mohin y Clerfayt, y Matthewsc. el Reino Unido, han sido fundamentales en la evolución de la interpretación de los derechos electorales en Europa.

La Comisión de Venecia y el Consejo para las Elecciones Democráticas han jugado un papel clave en la elaboración de normativas y recomendaciones en materia electoral, como el «Code of Good Practice in Electoral Matters», que busca orientar a los Estados en la creación de legislaciones electorales justas y democráticas.

La Carta de la OEA, junto con la Declaración Americana de los Derechos y Deberes delHombre y la Convención Americanasobre Derechos Humanos, establece principios y obligaciones claras para los Estados miembros en la promoción y consolidación de la democracia representativa, el respeto a los derechos humanos y la celebración de elecciones libres y justas.

Por su parte, la Carta Democrática Interamericana reafirma el derecho de los pueblos de América a la democracia y la obligación de los gobiernos de promoverla y defenderla, enfatizando la importancia de la participación ciudadana en un marco de legalidad y respeto al orden constitucional.

La Organización para la Seguridad y la Cooperación en Europa (OSCE) y, en particular, su Agencia Especializada ODIHR desempeña un papel fundamental en la promoción de elecciones democráticas y en la observación de procesos electorales. El Documento de Copenhague, reconocido como un texto internacional relevante en la instauración de principios de elecciones democráticas, sirve de guía para las actuaciones de la OSCE en materia electoral.

La Convención sobre los Estándares para Elecciones Democráticas, Derechos Electorales y Libertades (Minsk, 1995) aplicable a los países del CIS, ha sido objeto de reticencias por parte del Consejo de Europa, que lo considera menos protector y no completamente compatible con el CEDH (LA LEY 16/1950).

Finalmente, la Carta Africana sobre Democracia, Elecciones y Democracia (2007), aunque perteneciente al continente africano, es relevante por su promoción de elecciones regulares libres y justas como base para la legitimidad de los gobiernos, y por su influencia en el discurso global sobre democracia y elecciones.

Aunque en el actual marco normativo internacional no existe un artículo que aborde específicamente la incidencia de la IA en los procesos electorales, tras el análisis realizado podemos afirmar que existe un cuerpo legislativo suficiente que podría aplicarse en este contexto. Este marco, compuesto por una serie de instrumentos jurídicos y principios fundamentales, establece las bases para una regulación efectiva que, indirectamente, podría extenderse a la implementación y supervisión de la IA en las elecciones.

La aplicación de la IA en los procesos electorales debe alinearse con los principios establecidos en documentos como la Declaración Universal de Derechos Humanos (LA LEY 22/1948), el Pacto Internacional de Derechos Civiles y Políticos (LA LEY 129/1966), así como las normativas y directrices del Convenio Europeo para la Protección de los Derechos Humanos y de las Libertades Fundamentales (LA LEY 16/1950) y su Protocolo No 1. Estos documentos enfatizan la necesidad de asegurar elecciones libres, justas y transparentes, principios que deben guiar cualquier uso de la tecnología en este ámbito.

Además, la jurisprudencia del Tribunal Europeo de Derechos Humanos, junto con las recomendaciones de la Comisión de Venecia y el Consejo para las Elecciones Democráticas, proporcionan un marco interpretativo que puede aplicarse al uso de la IA en las elecciones, particularmente en lo que respecta a la protección de la libertad de expresión, la privacidad y la no discriminación.

Asimismo, la Carta de los Derechos Fundamentales de la Unión Europea (LA LEY 12415/2007) y los principios establecidos por la OSCE y la ODIHR ofrecen una base adicional para evaluar y regular el impacto de la IA en las elecciones, asegurando que su uso no comprometa los principios democráticos fundamentales.

VI. Marco regulatorio de la Unión Europea y de España

Conviene empezar este epígrafe señalando que, según el artículo 2 del Tratado de Lisboa, la Unión se fundamenta en los valores de respeto de la dignidad humana, libertad, democracia, igualdad, Estado de Derecho y respeto de los derechos humanos, incluidos los derechos de las personas pertenecientes a minorías. Estos valores son comunes a los Estados miembros en una sociedad caracterizada por el pluralismo, la no discriminación, la tolerancia, la justicia, la solidaridad y la igualdad entre mujeres y hombres.

El artículo 3 del Protocolo No 1 del Convenio Europeo para la Protección de los Derechos Humanos y de las Libertades Fundamentales (LA LEY 16/1950) (CEDH) establece un vínculo ineludible con el principio democrático representativo en la Unión Europea. Dado que todos los países miembros de la UE son también miembros del Consejo de Europa y han ratificado el CEDH (LA LEY 16/1950), se obligan a organizar elecciones libres a intervalos razonables, garantizando la libre expresión de la opinión del pueblo en la elección de sus cuerpos legislativos.

La Carta de los Derechos Fundamentales de la Unión Europea (LA LEY 12415/2007), proclamada originalmente en Niza y adaptada en 2007, establece en su Título V específicamente los derechos de sufragio:

- 1. artículo 39, que afirma el derecho de todo ciudadano de la Unión a participar activa y pasivamente en las elecciones al Parlamento Europeo, bajo las mismas condiciones que los nacionales del Estado miembro en que residan.

- 2. artículo 40, que viene a extender este derecho a las elecciones municipales, garantizando así una participación más directa y localizada en los procesos democráticos.

El artículo 6 del Tratado de la Unión Europea y la Incorporación de la Carta reconoce los derechos enunciados en la Carta, otorgándoles el mismo valor jurídico que los Tratados. Este reconocimiento implica que los derechos fundamentales y las libertades reconocidas por la Constitución de cada Estado miembro deben ser interpretados en conformidad con la Carta.

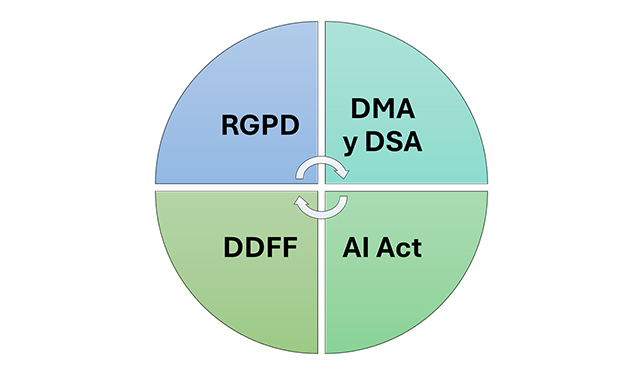

La Unión Europea ha sido pionera en la creación de un marco legal y regulatorio para abordar los desafíos planteados por la IA, especialmente en el ámbito político. Este marco legal se fundamenta en un enfoque que busca equilibrar la innovación tecnológica con la protección de los derechos fundamentales y los valores democráticos. La estrategia de la UE se basa en tres pilares principales: la protección de datos, la transparencia y la responsabilidad, y la equidad en el uso de la IA.

El RGPD establece normas estrictas para el tratamiento de datos personales, incluidos aquellos utilizados para alimentar sistemas de IA. Estas normas incluyen el derecho al consentimiento, el derecho a acceder a los propios datos y el derecho a ser olvidado. Este enfoque garantiza que la recolección y el uso de datos en aplicaciones de IA se realicen de manera ética y transparente.

En este sentido conviene recordar que el Supervisor Europeo de Protección de Datos emitió el 18 de marzo de 2018 su Opinión 3/2018 sobre «manipulación online y datos personales» (EDPS Opinion on online manipulation and personal data) (15) , así como la Guía de la Comisión Europea aprobada en 2018 antes de las elecciones europeas sobre la aplicación de la normativa europea de protección de datos en el contexto electoral (Commission guidance on the application of Union data protection law in the electoral context) (16) , en donde se expresaba su preocupación por el uso de la IA, el big data y la aplicación de microtargeting en los procesos electorales y que pueden llevar a la manipulación de las personas mediante la realización de perfilados exhaustivos y el fenómeno de las «fake-news» o «desinformación online».

En segundo lugar, las libertades como la libertad de pensamiento, de expresión y de información, y la libertad de reunión y asociación, se ven afectadas por la capacidad de las plataformas en línea para controlar y manipular la diseminación de información. Algoritmos que priorizan ciertos contenidos pueden afectar el pluralismo y la diversidad mediática, esenciales para una sociedad democrática.

En tercer lugar, la concentración de poder en conglomerados de medios y plataformas en línea amenaza el pluralismo y la diversidad de opiniones en el espacio público. Esto se evidencia en la disminución del periodismo local y el aumento de la desinformación. La influencia de los intermediarios en línea en el proceso político, ya sea por alineación ideológica o intereses comerciales, plantea serias preocupaciones sobre la imparcialidad y la equidad en la presentación de información política.

La influencia de la manipulación en línea y el microtargeting en las elecciones compromete principios clave de libertad, equidad y transparencia electoral. La capacidad de estas tecnologías para influir en la decisión política de los votantes, ya sea promoviendo a un candidato o desincentivando la participación electoral, plantea interrogantes sobre la igualdad de condiciones en las carreras electorales. La transparencia electoral se ve comprometida cuando los votantes no tienen acceso libre a información diversa y fidedigna sobre los procesos y candidatos electorales.

La aplicación de la normativa de competencia de la UE para proteger el pluralismo mediático y las llamadas a redefinir estas reglas en el contexto de la disrupción causada por las plataformas en línea, son reflejo de la necesidad de adaptar las políticas y legislaciones a estas realidades emergentes. En este punto cabe traer a colación el Paquete de la Ley de Servicios Digitales constituido por la Ley de Servicios Digitales (DSA) (17) y la Ley de Mercados Digitales (DMA) (18) .

El DSA exige una mayor transparencia en la publicidad en línea, incluida la publicidad política. Esto significa que las plataformas deben divulgar claramente quién está pagando por los anuncios políticos y cómo están siendo dirigidos. Esta transparencia es fundamental durante las campañas electorales, ya que permite a los votantes entender quién está tratando de influir en su opinión y con qué métodos. Además, el DSA establece normas más estrictas para las plataformas digitales en la gestión de la desinformación. Al requerir a las plataformas que aborden activamente la propagación de contenido falso o engañoso, se puede proteger la integridad del proceso electoral. Las plataformas digitales deben asumir una mayor responsabilidad por el contenido que hospedan. Esto incluye reforzar la supervisión de los contenidos relacionados con las elecciones y garantizar que las medidas de moderación de contenidos no sean arbitrarias o políticamente sesgadas.

Por su parte, el DMA se centra en prevenir prácticas comerciales desleales por parte de los gigantes tecnológicos, conocidos como gatekeepers o guardianes del mercado. Al promover la competencia y la equidad, se reduce el riesgo de que estas empresas influyan desproporcionadamente en la opinión pública, especialmente durante las elecciones. Asimismo, el DMA busca garantizar que los servicios y plataformas sean accesibles y no limiten injustamente la visibilidad de ningún actor político o de sus mensajes. Esto es crucial para garantizar que todos los candidatos y partidos tengan la oportunidad de llegar a su electorado sin ser injustamente obstaculizados por prácticas de mercado sesgadas. Al regular a los grandes intermediarios en línea, el DMA busca prevenir que estas entidades puedan abusar de su posición dominante para favorecer ciertas perspectivas políticas o influir en el proceso electoral.

En el contexto de la IA, la UE ha enfatizado la importancia de la transparencia y la responsabilidad. Esto se refleja en la recién aprobada Ley de Inteligencia Artificial

En el contexto de la IA, la UE ha enfatizado la importancia de la transparencia y la responsabilidad. Esto se refleja en la recién aprobada Ley de Inteligencia Artificial (AI Act) (19) , que busca regular el uso de sistemas de IA de alto riesgo, incluyendo aquellos utilizados en la toma de decisiones políticas y electorales. La propuesta incluye requisitos para que los desarrolladores y usuarios de IA proporcionen información clara sobre cómo funcionan sus sistemas, cómo se toman las decisiones y quién es responsable en caso de errores o daños.

La UE también está abordando el riesgo de sesgo y discriminación en los sistemas de IA. La propuesta de la Ley de IA incluye disposiciones para garantizar que los sistemas de IA sean justos y no perpetúen las desigualdades existentes. Esto implica la evaluación regular de los algoritmos para detectar y corregir sesgos, garantizando así que la IA no discrimine por motivos de raza, género, edad u otros factores protegidos.

A pesar de estos esfuerzos, el marco legal y regulatorio de la UE para la IA sigue enfrentando desafíos. Uno de ellos es mantenerse al día con el rápido avance tecnológico. Además, la implementación de estas regulaciones a nivel de los Estados miembros requiere un enfoque coherente y armonizado para garantizar su efectividad en todo el bloque.

A nivel nacional, el pluralismo político se configura como un valor superior del ordenamiento jurídico (artículo 1.1 CE (LA LEY 2500/1978)), el cual

- • permite contemplar en el marco de la Constitución diversas soluciones legales (STC 6/1984 (LA LEY 8478-JF/0000));

- • permite una libertad al legislador para apreciar la oportunidad o conveniencia de modificaciones normativas (STC 76/1990 (LA LEY 58461-JF/0000));

- • justifica que una misma corriente ideológica pueda tener diversas expresiones políticas que lleven a denominaciones parcialmente coincidentes (STC 107/1991 (LA LEY 1713-TC/1991));

- • impide que pueda ser ignorada la adscripción política de los representantes en la configuración de órganos en que se integran dichos representantes (STC 32/1985 (LA LEY 423-TC/1985)).

En relación con lo anterior, cabe traer a colación el artículo 23.1 CE (LA LEY 2500/1978), que exige unas elecciones periódicas y libres. Como venimos señalando, un riesgo significativo asociado con la IA es su uso en campañas de desinformación. La generación de noticias falsas, la difusión de información sesgada o la creación de perfiles falsos en redes sociales pueden manipular la percepción de los electores y, por ende, influir en sus decisiones de voto. Este fenómeno puede comprometer seriamente el principio de que los representantes sean libremente elegidos, ya que la manipulación informativa afecta la libertad y autenticidad del voto. Por otro lado, los algoritmos que personalizan el contenido pueden crear burbujas de filtro que limitan la exposición de los usuarios a una variedad de perspectivas y opiniones. Esta personalización, aunque eficiente en términos de marketing, puede sesgar la percepción de los electores sobre temas políticos y sociales, limitando así la libre formación de sus opiniones.

La preocupación europea en relación con el impacto de las nuevas tecnologías en los derechos fundamentales en materia electoral se vio reflejada en una modificación en la Ley Orgánica 5/1985, de 19 de junio, del Régimen Electoral General (LA LEY 1596/1985) (LOREG (LA LEY 1596/1985)) a través de la disposición final tercera de la Ley Orgánica 3/2018, de 5 de diciembre, de Protección de Datos Personales y garantía de los derechos digitales (LOPDGDD) (LA LEY 19303/2018), introduciendo el artículo 58 bis con el fin de regular específicamente la recopilación y tratamiento de opiniones políticas por los partidos políticos así como el envío de propaganda electoral. En relación con lo anterior, la Agencia Española de Protección de Datos, aprobó la Circular 1/2019, de 7 de marzo (LA LEY 3216/2019), sobre el tratamiento de datos personales relativos a opiniones políticas y envío de propaganda electoral por medios electrónicos o sistemas de mensajería por parte de partidos políticos, federaciones, coaliciones y agrupaciones de electores al amparo del artículo 58 bis de la Ley Orgánica 5/1985, de 19 de junio, del Régimen Electoral General (LA LEY 1596/1985) (20) .

En la citada Circular se recuerda que el tratamiento de datos personales por parte de los partidos políticos, así como por el resto de sujetos que pueden presentar candidaturas en los procesos electorales, queda sujeto a la normativa general sobre protección de datos personales. La Agencia, basándose en el informe jurídico de su Gabinete Jurídico de 19 de diciembre de 2018 adopta una interpretación restrictiva «avalada por la necesidad de que el artículo 58 bis sea interpretado conforme a lo establecido en la Constitución española (LA LEY 2500/1978) y de modo que no conculque derechos fundamentales, como el derecho a la protección de datos de carácter personal reconocido en el artículo 18.4, el derecho a la libertad ideológica del artículo 16, la libertad de expresión e información del artículo 20 o el derecho a la participación política del artículo 23».

En particular el artículo 9.2.g) del RGPD (LA LEY 6637/2016) (21) requiere que se establezcan medidas adecuadas y específicas para proteger los intereses y derechos fundamentales de los afectados. Como el legislador no ha adoptado un marco jurídico adecuado ante tal riesgo para los derechos y libertades de las personas, la Agencia se vio obligada a identificar las medidas para proteger los derechos afectados, entre las que destacan las relativas a la evaluación de impacto, la consultaprevia a la AEPD o la adopción de las oportunas medidas de seguridad.

VII. Marco jurídico de la IA en las elecciones estadounidenses

En Estados Unidos, el uso de la IA en el contexto electoral ha llevado a una serie de desarrollos legislativos a nivel estatal. Estas leyes buscan abordar los retos emergentes relacionados con la IA, particularmente en lo que respecta a la desinformación, los deepfakes y otras formas de contenido generado por IA que pueden influir en el proceso electoral. Examinaremos algunas legislaciones clave y su impacto en el marco legal de las elecciones estadounidenses.

El Código Electoral de California (Sección 20010) (22) de 2019 prohíbe la publicación de medios engañosos 60 días antes de una elección en la que un candidato aparezca en la boleta, a menos que se incluya una divulgación de que el medio ha sido manipulado. Esta ley refleja una preocupación por la integridad de la información electoral y busca prevenir la difusión de contenido falso que podría confundir o engañar a los votantes.

Las leyes de Michigan (MCL §§168.932f, 169.247) (23) de 2023 exigen una divulgación en anuncios políticos generados por IA y prohíben la publicación de medios engañosos 90 días antes de una elección. Esta legislación destaca la importancia de la transparencia en el uso de tecnologías avanzadas en la propaganda política.

Tanto Minnesota como Texas han promulgado leyes que prohíben específicamente la publicación de deepfakes (Minn. Stat §609.771 en Minnesota (24) y Tex. Election Code Ann. §255.004 en Texas (25) ). Estas leyes son indicativas de la preocupación creciente por el uso de deepfakes en la manipulación de la opinión pública y el proceso electoral.

El Código Revisado de Washington (Sección 42.62.020) (26) de 2023 exige una divulgación en medios sintéticos utilizados para influir en una elección, reflejando un esfuerzo por garantizar que los votantes estén conscientes de la naturaleza artificial de ciertos contenidos.

Además de estas leyes estatales, varias propuestas legislativas recientes indican una tendencia hacia una regulación más estricta del uso de IA en las elecciones. Por ejemplo, en Arizona, el proyecto de ley SB 1565 (27) , que buscaba prohibir el uso de IA en máquinas y software de votación, fue vetado, mostrando las tensiones y debates en curso sobre el alcance adecuado de la regulación de la IA en el proceso electoral.

El panorama legislativo en los Estados Unidos respecto al uso de la IA en las elecciones es diverso y en evolución. Estas leyes y propuestas legislativas reflejan un esfuerzo por abordar los desafíos únicos que presenta la IA, como la diseminación de desinformación y la manipulación de electores a través de medios artificiales. Sin embargo, también destacan los desafíos en la creación de un marco jurídico coherente y efectivo a nivel nacional, dada la naturaleza descentralizada del sistema electoral estadounidense.

VIII. Hacia un futuro equilibrado: propuestas y recomendaciones

La administración electoral debe adoptar un enfoque metódico y transparente al considerar la implementación de la IA. Este enfoque debería incluir una cuidadosa selección del sistema de IA adecuado, una planificación detallada para su integración y una revisión minuciosa para asegurar la precisión y fiabilidad de sus resultados.

La selección de cualquier herramienta, ya sea basada en IA o no, debe realizarse con cautela. Se recomienda priorizar la simplicidad, ya que los sistemas más sencillos son generalmente más transparentes y fáciles de gestionar. En el caso de que surjan dudas o problemas, será más fácil abordarlos con un modelo de IA menos complejo.

Es crucial que los sistemas de IA que puedan afectar el registro de votantes o el conteo de votos incluyan la intervención humana en las decisiones finales. Esta participación humana es esencial para proteger contra posibles irregularidades o sesgos en el rendimiento de la IA.

Las oficinas electorales deben prepararse para la posibilidad de que los sistemas de IA no funcionen tan eficientemente como prometen los proveedores. Debido a las peculiaridades de los datos y a las variaciones entre distritos y grupos poblacionales, el rendimiento de la IA puede diferir significativamente en situaciones reales.

Debe haber un plan exhaustivo que aborde tanto los aspectos internos como externos de la implementación de la IA. Esto incluye la formación del personal, la reorganización de procesos y flujos de trabajo, y la asignación de responsabilidades de supervisión. También es importante informar al público sobre el propósito y la funcionalidad de la IA y establecer planes de contingencia para manejar posibles fallos.

Las revisiones sistemáticas son fundamentales para el uso exitoso de herramientas de IA. Estas revisiones deben abarcar la recopilación y evaluación de problemas identificados tanto por el personal interno como por los electores, y deben realizarse antes y después de las elecciones para garantizar la precisión y la justicia en todo el proceso electoral.

Las decisiones que afectan directamente el derecho al voto y la capacidad de emitir un voto no deben dejarse exclusivamente a la IA. Los funcionarios electorales deben estar involucrados en la revisión de decisiones significativas basadas en el análisis y la información generados por la IA.

Es imperativo que existan procedimientos claros y accesibles para que los electores impugnen decisiones impulsadas por la IA. Deben establecerse procesos para apelar y revisar dichas decisiones, garantizando así un nivel adicional de protección para los derechos de voto y una evaluación continua del rendimiento de los sistemas de IA en la administración electoral.

Más allá de la regulación existente, que tiene una perspectiva centrada exclusivamente en la ética y los derechos humanos, devienen necesarios mecanismos de protección jurisdiccionales. Al igual que el legislador se ha apresurado a introducir medidas en la Administración de Justicia para el uso de la IA en la elaboración de documentos procesales, debería introducir procedimientos concretos para proteger aspectos tan relevantes del Estado de Derecho. Así, se sugiere la creación de un procedimiento especial ante la jurisdicción contencioso-administrativa de protección de derechos fundamentales para el caso en que se hayan violado éstos por culpa de un uso inapropiado de sistemas de IA.

IX. Entre la regulación tecnológica y la responsabilidad humana

Nos encontramos ante un dilema ético y jurídico de gran envergadura, uno que pone a prueba los cimientos de nuestra comprensión del derecho y la ética en el contexto de la IA y las nuevas tecnologías. Este dilema se despliega en dos frentes principales, cada uno con sus propios matices y complejidades.

Por un lado, tenemos la imperiosa necesidad de regular la IA y las tecnologías emergentes. Esta perspectiva, arraigada en un axioma de precaución tecnológica, parte de la premisa de que mientras la innovación tecnológica es una fuente indiscutible de progreso, también acarrea riesgos que no pueden ser ignorados. Surge aquí una cuestión fundamental: ¿Cómo podemos, como sociedad, promover la innovación tecnológica y al mismo tiempo salvaguardar al público de sus posibles efectos adversos? Este es el gran desafío de la teoría del derecho en la era digital, que requiere un equilibrio delicado entre fomentar el avance tecnológico y proteger los derechos y la seguridad de las personas.

Por otro lado, pudiera parecer que la regulación de la IA no es solo una opción, sino un deber para asegurar que su evolución esté alineada con los principios éticos y los derechos fundamentales. Sin embargo cabe recordar que la IA, como herramienta, es esencialmente neutral y que son las intenciones y acciones humanas las que determinan su impacto, entonces surge una perspectiva alternativa: la solución a los retos éticos y morales asociados con la IA no reside necesariamente en la imposición de reglas y límites externos, sino en el desarrollo y la mejora del carácter moral y la integridad de quienes la desarrollan y utilizan. El debate se adentra en la naturaleza intrínseca del ser humano, explorando si los desafíos que enfrentamos con la tecnología son, en realidad, un reflejo de nuestras propias fallas: la deshonestidad, la manipulación y una ética deficiente. La tecnología actúa como un espejo de nuestra sociedad, revelando tanto nuestras virtudes como nuestros defectos.

Es crucial desarrollar un pensamiento crítico robusto y una habilidad para reconocer la información veraz en un mundo inundado de datos manipulables. Al restringir la tecnología, ¿estamos acaso impidiendo el desarrollo de estas habilidades críticas en los individuos?

Desde un punto de vista teleológico, la finalidad del derecho en la era de la IA no debería ser simplemente regular por regular, sino hacerlo de manera que se salvaguarden y promuevan los valores y objetivos fundamentales de la sociedad. Es un proceso de equilibrar la innovación y el progreso tecnológico con la necesidad de preservar y fomentar un entorno social y ético sostenible y justo.

X. Conclusiones

El análisis del rol creciente de la IA en el contexto político y electoral revela un escenario complejo donde la innovación tecnológica se entrelaza con profundos dilemas éticos y legales. La capacidad de la IA para procesar y analizar grandes volúmenes de datos ha abierto nuevas dimensiones en la estrategia y gestión políticas, ofreciendo una comunicación más directa y personalizada con los votantes. Sin embargo, esta evolución tecnológica también introduce desafíos significativos que requieren una consideración cuidadosa.

La utilización de la IA en la política, particularmente en las campañas electorales, plantea serios riesgos de manipulación y desinformación. Herramientas como los bots y las técnicas de microsegmentación, si se emplean de manera inadecuada, tienen el potencial de difundir información falsa y distorsionar el debate público. Además, el riesgo de sesgo algorítmico en los sistemas de IA, debido a la dependencia de datos históricos, puede resultar en decisiones políticas que perpetúan y amplifican desigualdades preexistentes.

A nivel legal, tanto en la Unión Europea como en Estados Unidos, se observa una tendencia hacia una regulación más estricta en el uso de la IA en contextos electorales. La UE ha implementado normativas como el RGPD y propuesto la Ley de Inteligencia Artificial, enfocándose en la protección de datos, la transparencia y la responsabilidad. En Estados Unidos, diversas legislaciones estatales están abordando los retos relacionados con la desinformación y los deepfakes en el proceso electoral.

Resulta esencial lograr un balance entre el fomento de la innovación tecnológica y la protección de principios democráticos. Esto implica asegurar transparencia en el uso de la IA y promover un entendimiento público amplio sobre su influencia en la política. Un marco regulatorio efectivo debe proteger los derechos individuales y mantener la integridad del proceso democrático.

El desafío trasciende la mera regulación tecnológica y abarca una responsabilidad humana más amplia. La IA, como herramienta, es neutral, y son las acciones humanas las que determinan su impacto en la sociedad. Por lo tanto, la solución a los retos éticos asociados con la IA puede encontrarse tanto en el desarrollo de una ética tecnológica robusta como en fomentar la integridad entre quienes desarrollan y utilizan esta tecnología. En consecuencia, el papel del derecho en la era de la IA debería ser equilibrar la innovación tecnológica con la necesidad de un entorno social y ético justo y sostenible.

La integración de la IA en los procesos políticos y electorales ofrece oportunidades sin precedentes y presenta desafíos notables. En esta era digital, es crucial que la comunidad internacional, los legisladores, los desarrolladores de IA y la sociedad en su conjunto colaboren para asegurar que el uso de la IA en la política sea ético, responsable y coherente con los principios democráticos fundamentales.

¿Cómo aseguramos unas elecciones libres y auténticas en el Estado de Derecho ante la IA?

Elaboración propia

XI. Bibliografía y referencias

Tribunal Constitucional de España. (1984). STC 6/1984, de 24 de enero (LA LEY 8478-JF/0000). BOE núm. 42, de 18 de febrero de 1984.

Tribunal Constitucional de España. (1990). STC 76/1990, de 26 de abril (LA LEY 58461-JF/0000). BOE núm. 109, de 7 de mayo de 1990.

Tribunal Constitucional de España. (1991). STC 107/1991, de 13 de mayo (LA LEY 1713-TC/1991). BOE núm. 121, de 21 de mayo de 1991.

Naciones Unidas. (1948). Declaración Universal de Derechos Humanos (LA LEY 22/1948).

Naciones Unidas. (1966). Pacto Internacional de Derechos Civiles y Políticos (LA LEY 129/1966).

Consejo de Europa. (1950). Convenio Europeo para la Protección de los Derechos Humanos y de las Libertades Fundamentales (LA LEY 16/1950) y su Protocolo No 1.

Tribunal Europeo de Derechos Humanos. Caso Mathieu-Mohin y Clerfayt.

Tribunal Europeo de Derechos Humanos. Caso Matthews c. el Reino Unido.

Comisión de Venecia y Consejo para las Elecciones Democráticas. «Code of Good Practice in Electoral Matters».

Organización de los Estados Americanos. Carta de la OEA y Declaración Americana de los Derechos y Deberes del Hombre.

Organización de los Estados Americanos. Convención Americana sobre Derechos Humanos.

Organización de los Estados Americanos. Carta Democrática Interamericana.

Organización para la Seguridad y la Cooperación en Europa (OSCE) y su Agencia Especializada ODIHR.

Consejo de Europa. Convención sobre los Estándares para Elecciones Democráticas, Derechos Electorales y Libertades (Minsk, 1995).

Unión Africana. Carta Africana sobre Democracia, Elecciones y Democracia (2007).

Unión Europea. Carta de los Derechos Fundamentales de la Unión Europea (LA LEY 12415/2007) (2007).

Osborne, S. (2024). Uso de la IA en elecciones: El caso de New Hampshire. Sky News. Recuperado de http://www.skynews.com/new-hampshire-ia

Wolf, Z. B. (2024). Deepfakes en la política estadounidense: Un análisis. CNN. Recuperado de http://www.cnn.com/deepfakes-politica

España. (2018). Ley Orgánica 3/2018, de 5 de diciembre, de Protección de Datos Personales y garantía de los derechos digitales (LA LEY 19303/2018). Boletín Oficial del Estado, núm. 294, de 6 de diciembre de 2018.

España. (1985). Ley Orgánica 5/1985, de 19 de junio, del Régimen Electoral General (LA LEY 1596/1985) (LOREG (LA LEY 1596/1985)).

Unión Europea. (2016). Reglamento (UE) 2016/679 del Parlamento Europeo y del Consejo de 27 de abril de 2016 relativo a la protección de las personas físicas en lo que respecta al tratamiento de datos personales y a la libre circulación de estos datos (LA LEY 6637/2016) (Reglamento General de Protección de Datos (LA LEY 6637/2016)).

Unión Europea. (2022). Reglamento (UE) 2022/2065 del Parlamento Europeo y del Consejo de 19 de octubre de 2022 (LA LEY 22694/2022) relativo a un mercado único de servicios digitales y por el que se modifica la Directiva 2000/31/CE (LA LEY 7081/2000) (Reglamento de Servicios Digitales).

Unión Europea. (2022). Reglamento (UE) 2022/1925 del Parlamento Europeo y del Consejo de 14 de septiembre de 2022 (LA LEY 21630/2022) sobre mercados disputables y equitativos en el sector digital (Reglamento de Mercados Digitales).

Unión Europea. (2007). Carta de los Derechos Fundamentales de la Unión Europea (LA LEY 12415/2007).

Supervisor Europeo de Protección de Datos. (2018). Opinión 3/2018 sobre «manipulación online y datos personales». Recuperado de https://edps.europa.eu/sites/edp/files/publication/18-03-19_online_manipulation_en.pdf

Comisión Europea. (2018). Guía sobre la aplicación de la normativa europea de protección de datos en el contexto electoral. Recuperado de https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX%3A52018DC0638

España. (1978). Constitución Española (LA LEY 2500/1978).

Agencia Española de Protección de Datos. (2019). Circular 1/2019 (LA LEY 3216/2019) sobre el tratamiento de datos personales y envío de propaganda electoral. Recuperado de http://www.aepd.es/circular1_2019

Unión Europea. (2023). Ley de Inteligencia Artificial de la Unión Europea. Propuesta de Regulación. Recuperado de http://www.europa.eu/ai-act

California. (2019). Código Electoral, Sección 20010. Recuperado de http://www.leginfo.california.gov

Michigan. (2023). Leyes, MCL §§168.932f, 169.247. Recuperado de http://www.legislature.mi.gov

Washington. (2023). Ley del Código Revisado, Sección 42.62.020. Recuperado de http://www.leg.wa.gov