Introducción

Datos, datos y más datos. La Inteligencia Artificial, como cualquier tecnología digital, requiere para su desarrollo y funcionalidad de datos. Cuantos más, mejor. Y así ocurre, pues no es una excepción, con la I.A Generativa y el resto de aplicaciones orientadas a la creación de discursos de narración basados en conocimientos preliminares adquiridos mediante aprendizaje y adiestramiento.

En los últimos años la Inteligencia Artificial se ha convertido en una realidad que, al menos, empieza a generar cierta preocupación en los poderes normativos. Así lo hemos visto con las iniciativas de la Unión Europea sobre la materia o las referencias a este tipo de tecnología en leyes nacionales como la Ley 15/2022, de 12 de julio, integral para la igualdad de trato y la no discriminación (LA LEY 15917/2022). La Inteligencia Artificial ya está entre nosotros, pero qué impacto tendrá en la economía, en el ámbito legal, en las profesiones jurídicas.

No podemos desconocer que algunas tareas jurídicas (escritos de trámite, resoluciones estereotipadas) pueden llevarse a cabo de manera más ágil a través de la tecnología, mediante las aplicaciones adecuadas. Ahora bien, ¿esas aplicaciones pueden desempeñar sus funciones desde un diálogo generativo autónomo o es precisa una intervención humana? ¿Quién controla las cesiones de datos que exigen estos operativos para poder evolucionar y mejorar? ¿Podrán sustituir estas aplicaciones la labor de abogados o jueces en determinados procedimientos? ¿Quizá en los más sencillos?

Los interrogantes que la tecnología generativa basada en I.A plantean actualmente son demasiados y las certezas son pocas. Desde esta comprobación, y dada cuenta la relevancia del sector jurídico en cualquier sociedad contemporánea, es pertinente abrir un debate riguroso y sereno sobre qué la I.A Generativa y, ante todo, sobre cuáles pueden ser las consecuencias de implantarlo en el marco ordinario en el que se desenvuelven las profesiones jurídicas.

¿Qué contestaría a estas preguntas la I.A Generativa?

Primeramente, cedamos su turno a las inteligencias «humanas».

1º. ¿Qué es la I.A Generativa? ¿Cómo funciona? ¿Para qué sirve?

Alfonso Peralta Gutiérrez (Juez)

«Lo cierto es que siendo juristas no me atrevo a hacer una definición de la IA generativa que no sea la legal. En el próximo Reglamento Europeo de Inteligencia artificial se introdujo la enmienda que define los modelos fundacionales como un modelo de sistema de IA entrenado con un gran volumen de datos, diseñado para producir información de salida de carácter general y capaz de adaptarse a una amplia variedad de tareas diferentes. Es decir, a partir de preguntas o comandos "prompt", te genera un resultado o información de salida. El Parlamento Europeo introdujo esta enmienda junto con la regulación como sistema de alto riesgo a raíz de la revolución que han supuesto estos sistemas de IA, su complejidad, su potencial impacto y riesgos que ya estamos viendo en múltiples ámbitos y la necesidad de su gobernanza.

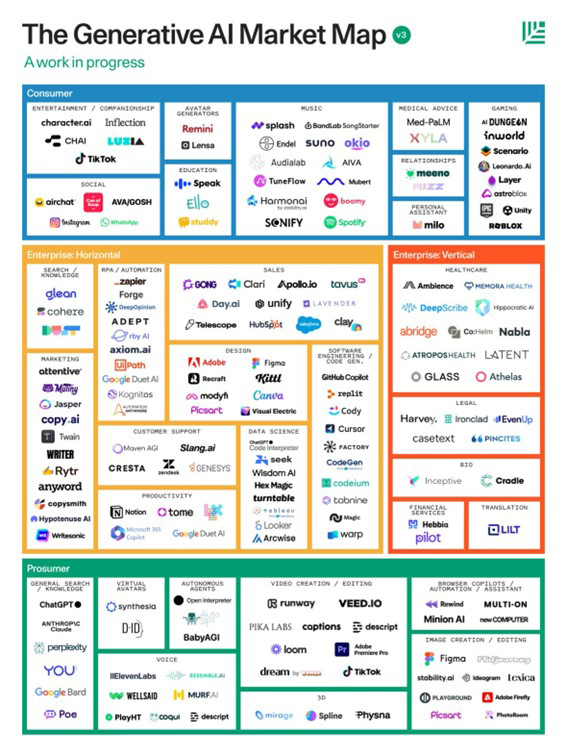

En cuanto a sus posibles propósitos, Sequoia ha diseñado un mapa de actuales herramientas y utilidades de IA generativa. Un mapa que en un año se ha multiplicado. Y creo que hacia donde vamos es hacia IAs generativas específicas utilizando APIs y datos propios para sectores y empresas y con prompts sencillos y fáciles de utilizar. Es decir, pasamos de IAs generadoras de texto, imagen, vídeo, voz, o 3D a IAs para empresas y administraciones, sector salud, jurídico, videojuegos, negocios, diseño, etc. Y sobre todo entiendo que de un aprendizaje no supervisado a uno más supervisado a través de ajuste fino (fine tunning) y unos datos propios mucho más relevantes, fiables, robustos, y sobre todo legales y legítimos. No es lo mismo pedirle a ChatGPT que te escriba una carta para alguien en un cierto tono, con ciertos requisitos. Que pedir te lo haga de manera similar o igual a tus cientos de cartas que tienes almacenadas en tu disco duro o en el buzón de email.»

Cristina Retana Gil (Directora de Contenidos e Innovación en Aranzadi LA LEY)

En lo que nos interesa como juristas, la inteligencia artificial generativa pertenece a la disciplina científica de la inteligencia artificial, en concreto, a la rama de los llamados «grandes modelos lingüísticos» o LLM, por las siglas en inglés de large language models, y están basados en deep learning o aprendizaje profundo. Desde que en noviembre pasado conocimos la versión 3 de GPT, herramientas como el propio ChatGPT de OpenAI, Bing, Bard de Google o LLaMA de Meta, nos han sorprendido, sobre todo, por su increíble capacidad de sintaxis y construcción gramatica, de una apariencia absolutamente humana. Técnicamente, cuando trabajan con textos, funcionan realizando cálculos probabilísticos de la palabra que aparecerá a continuación, sin entender el significado de lo que muestran. Este tipo de sistemas toma fragmentos de texto de los contenidos escaneados, los junta y los devuelve al usuario, sin comprender la relación entre estos fragmentos. Pero no debemos olvidar que son tecnologías multimodales, de manera que la música o los diseños, fotografías o videos, también pueden ser tanto inputs como outputs de estos modelos.

Sorprende, decía, su capacidad de generar. Es una generación que, en las interfaces más recientes parte de una pregunta (prompt) del usuario, y genera una respuesta nutriéndose de la información que tiene acumulada. El tiempo nos va demostrando que los usos y aplicaciones de todas estas herramientas se irán prodigando y ampliando y, en mi opinión, los usos variarán mucho en función del ámbito en el que se produzcan. Me refiero a los ámbitos personales y profesionales. En este segundo contexto, el profesional, creo que la IA generativa abre un abanico de oportunidades que cada sector, cada organización, cada profesional, debe analizar en profundidad, sin descuidar la fiabilidad jurídica de este tipo de tecnología que, sin duda, van a convertirse en una herramienta de apoyo diario, y no de sustitución de la labor jurídica. Hay que plantearse muchas preguntas: ¿cómo puede ayudar esta tecnología a mis clientes?, ¿a mi día a día?, ¿a mis procesos? ¿Cuánto me va a costar?, ¿cómo abordar el o los proyectos? Y hay que hacerlo de manera rápida pero segura y fiable, junto a los mejores profesionales, en equipos multidisciplinares, conociendo el funcionamiento de la tecnología para así proteger nuestros datos y los de nuestros clientes, y caminando con ellos para apoyarles en sus tareas de la mejor manera posible.

Gerard Espuga Torné (Abogado)

«Podemos definir la IA como la capacidad de una máquina de actuar como lo hace una mente humana, considerando sus aspectos de creatividad y capacidad de realizar análisis e inferencias a partir de información compleja, e incluso incompleta, es decir, un sistema que puede "pensar" de manera similar a como lo haría una mente humana.

La IA generativa es una categoría de inteligencia artificial que produce resultados nuevos a partir de los datos que se han utilizado para entrenar el modelo. La IA generativa produce respuestas a preguntas formulada en lenguaje natural, esto es, lenguaje humano. Entre otras IA generativas, por ejemplo, ChatGPT que es un chatbot conversacional, o Midjourney que genera imágenes a través de las solicitudes formuladas por los usuarios.

En la versión del Parlamento Europeo sobre el Reglamento de Inteligencia Artificial se define la IA generativa como un tipo de modelo «fundacional», esto es, aquellos modelos entrenados con grandes conjuntos de datos, diseñados para obtener resultados generales que pueden usarse para muchas tareas diferentes. Los sistemas de IA generativa son un subconjunto específico de modelos fundacionales "destinados específicamente a generar, con distintos niveles de autonomía, contenidos como textos, imágenes, audio o vídeos complejos".»

Nuria Rando Rando (Abogada en RocaJunyent-Gaona, Palacios y Rozados y Coordinadora de la Sección de Derecho Digital e Innovación en Abogacía de Málaga)

«Definir la IA Generativa y su funcionamiento es todo un reto para una jurista. No obstante, definiría la IA Generativa como una tecnología, que a través del análisis de datos masivos no estructurado (voz, fotos, textos, audios, etc.) ejecutando algoritmos y redes neuronales, tiene la capacidad aprender y reproducir habilidades eminentemente humanas como, por ejemplo, el razonamiento, la creatividad o el lenguaje natural y con ello, puede ofrecer respuestas y contenido original, es decir nuevo y único. El ejemplo de IA generativa más conocido es ChatGPT.

La IA Generativa tiene infinidad de usos y en sectores muy distintos. Actualmente, de los usos más extendidos de procesamiento de lenguaje natural están ChatGPT o Bard. En generación de imágenes está Midjourney. En el mundo jurídico, ya se están desarrollando y comercializando modelos de IA Generativa para facilitar la labor de los profesionales del derecho, por ejemplo, GenIA-L o chats para resolución de consultas jurídicas.»

M.ª Paloma Abad Tejerina (Abogada)

«La inteligencia artificial generativa es un campo que se centra en la creación de datos procedentes de bases amplísimas, que finalmente permiten generar contenidos de una manera autónoma. Es decir que utilizará modelos para generar información nueva y coherente en función de patrones aprendidos a partir de la recopilación de numerosos datos, hoy entre los que se encuentran no solamente datos escritos sino vídeos, imágenes, etc.

Su funcionamiento por ello se basa en el entrenamiento partiendo de una gran cantidad de datos de entrada. Hoy los modelos que se van incorporando y se utilizan para generar nuevos datos que son coherentes o que pueden ser coherentes y relevantes en la pregunta o en la actividad para la que se pide respuesta a la IA.

Conforme a mi opinión, la IA puede:

- 1º.- Generar textos con contenido escrito como artículos o respuestas a preguntas.

- 2º.- Crear imágenes, música, diseños (aunque las imágenes que he visto al momento presente no están muy perfeccionadas).

- 3º.- Sirve también para hacer traducción automática de un idioma a otro, por lo que va a permitir una mejor comunicación entre los individuos.

- 4º.- Y al tener una base de datos amplísima, recopila información sobre un determinado tema de diferentes países que finalmente se ven recopilados en una sola información.»

2º. ¿Qué funciones podría atender una aplicación como la I.A Generativa en el sector jurídico?

Alfonso Peralta Gutiérrez (Juez)

«En general el ámbito jurídico es un sector preeminentemente escrito. Por lo tanto, tendrá mucha importancia en creación de texto y análisis de manera automatizada. Tareas más rutinarias y de menos valor añadido, como contestar emails, redactar cartas o burofaxes, facturación, contabilidad, gestión de asuntos… Pero también para resumir documentos, buscar dentro de ellos, traducirlos, para buscar jurisprudencia, alegaciones o fundamentos de una manera más sencilla, para tomar notas o para transcribir por ejemplos juicios, reuniones o conferencias de manera automática. Sin embargo, hemos visto que supuestos anuncios del «primer abogado robot» que iba a jubilar a la abogacía han acabado en fracaso, con resultados de mala calidad y edición, ausencia de análisis jurídico, o por ejemplo jueces y abogados que han usado ChatGPT en otros países y no han revisado las referencias, han acabado citando sentencias y leyes falsas o inexistentes. Se trata de sistemas de procesamiento de lenguaje natural, pero una cosa es tener información y otra el conocimiento para comprenderla y evaluarla conforme a su contexto, y la sabiduría para interpretarla y aplicarla a su situación o a problemas distintos.»

Cristina Retana Gil (Directora de Contenidos e Innovación en Aranzadi LA LEY)

Hemos podido comprobar que esta tecnología tiene una probada capacidad en resumir documentos no excesivamente extensos o extraer de ellos ciertos datos, traducir textos a cualquier idioma, ofrecer borradores de documentos básicos, determinar una temática sobre una consulta, o proponer incluso una mejor redacción de un texto. Pero hay dos factores clave que no debemos olvidar en relación a su uso en el ámbito legal, la fiabilidad jurídica y la protección de datos o confidencialidad.

Todos los casos de uso en el ámbito jurídico tienen que estar en un entorno tecnológico securizado y las respuestas basadas o entrenada la tecnología en fuentes de información confiable y actualizadas con los cambios legales. Las decisiones que los operadores jurídicos tienen que adoptar, han de realizarse sobre la base de fuentes de información fiables y rigurosas, porque incluso pequeños errores o inexactitudes en el contenido pueden tener consecuencias graves en su actuación jurídica.

A lo anterior, añadiría las oportunidades para los formadores jurídicos (permite explicar de modo sencillo conceptos complejos), y de completar documentos (formularios, plantillas, facturas, etc.) «poblándolos» con datos de CRMs, por ejemplo. Además, por supuesto, de las ventajas en la generación de códigos (informáticos) que pueden mejorar y acelerar los softwares jurídicos. De hecho, veo mucho recorrido para herramientas de análisis financiero y de compliance normativo.

Gerard Espuga Torné (Abogado)

«El sector jurídico, mediante el uso de modelos de IA generativa, tomando todas las cautelas necesarias, podría ver incrementada su eficiencia y eficacia mediante la automatización de tareas de poco o escaso valor jurídico añadido para permitir, a su vez, a los operadores jurídicos poder centrarse en aquellas tareas más complejas o de mayor valor añadido.

Dejando a un lado las implicaciones legales que pueda tener el uso de estos sistemas y centrándonos en un punto de vista eminentemente práctico, la IA generativa puede permitir, entre otras aplicaciones: el análisis de documentos y extracción de información relevante, la detección de incongruencias legislativas, la realización de resúmenes de contratos, documentos o textos legales, automatización de determinados tipos de respuestas o consultas legales (insisto, con todas las cautelas) o la búsqueda de jurisprudencia, e incluso el análisis de patrones o predicción de los resultados en un procedimiento legal teniendo en cuenta los antecedentes.

Como vemos, entre las posibilidades que nos ofrece esta tecnología, hay tareas más o menos repetitivas o más o menos automatizables, pero también posibilita otros usos que conllevan un mayor riesgo o que pueden tener una mayor afectación para los derechos fundamentales de los individuos, y son en estos últimos usos en los que debe centrarse, sobre todo, la regulación.»

Nuria Rando Rando (Abogada en RocaJunyent-Gaona, Palacios y Rozados y Coordinadora de la Sección de Derecho Digital e Innovación en Abogacía de Málaga)

«Como ya se ha adelantado en la pregunta anterior, la IA Generativa puede tener muchas funcionalidades como por ejemplo, proporcionar respuestas con razonamientos lógicos sobre preguntas planteadas con implicaciones jurídicas o normativas, analizar documentos y extraer resúmenes y/o conclusiones de los mismos así como, detectar potenciales riesgos en dichos documentos (muy útil para procesos de Due Diligence en los que se suelen analizar cláusulas de vencimientos, penalizaciones o cambios de control o incluso para análisis de prueba documental en procesos judiciales), analizar textos normativos que frecuentemente pueden ser densos o con muchas referencias a otras normas o disposiciones que dificultan su lectura, proporcionar rápidamente plantillas o modelos de contratos o cláusulas sobre los que trabajar.

Pienso que la IA Generativa en el sector legar puede ser una gran aliada para mejorar la atención al cliente, puede ayudar a dar información sobre el estado de sus procedimientos o asuntos, ayudar con la gestión de las citas en los despachos y, entre otros, responder consultas básicas.»

M.ª Paloma Abad Tejerina (Abogada)

«Pienso que puede desempeñar muchas funciones útiles en nuestro sector jurídico, entre las que podrían ser:

- a) Redacción de documentos legales sencillos, o de los que parten de plantillas y datos proporcionados por abogados, por lo que ahorra tiempo en la preparación de documentos estándar.

- b) Generar resúmenes legales de documentos que son extensos e identificando cuáles son los puntos más importantes y las implicaciones que puede haber.

- c) Recopilar la información de muchos países y las soluciones que se ha dado a ese determinado problema o concepto jurídico en cada uno de los países o zonas geográficas.

- d) Automatización de tareas administrativas, como pueden ser la gestión de citas y seguimiento de plazos gestión de documentos, etc.

- e) Traducción.

3.º ¿Podría llegar a sustituir a determinados abogados? ¿A jueces? ¿A otros operadores?

Alfonso Peralta Gutiérrez (Juez)

«Incluso si preguntamos a ChatGPT si sustituirá a jueces o abogados nos dice que no. Estas herramientas no sustituirán a los abogados, ni a corto plazo veremos «abogados robots». También están lejos los jueces androides. Todo eso es humo y titulares de clickbait. La inteligencia artificial será una herramienta a la que muchos nos habituaremos al igual que el procesador de textos, las bases de datos legales o buscar en internet. Habilidades como la experiencia práctica, la intuición, la adaptabilidad a situaciones cambiantes, la empatía, la persuasión, la negociación o la originalidad y creatividad (sobre todo thinking outside the box o pensar imaginativamente fuera de lo convencional y existente) son insustituibles por una máquina. Así, el mercado laboral requerirá un número cada vez mayor de soft skills como las mencionadas.

Un buen jurista no sólo deberá formarse en derecho digital y en su normativa, sino también en aprovechar las herramientas tecnológicas para obtener una mayor productividad y eficiencia

Lo que sí es verdad es que un buen jurista no sólo deberá formarse en derecho digital y en su normativa, sino también en aprovechar las herramientas tecnológicas para obtener una mayor productividad y eficiencia y dedicarse a las tareas de mayor valor añadido, automatizando aquellas más simples, repetitivas y menos creativas.

La inteligencia artificial no sustituirá a jueces ni a abogados, pero sí se producirá una brecha digital y de productividad entre aquellos que sepan aprovechar las nuevas herramientas y los que no.»

Cristina Retana Gil (Directora de Contenidos e Innovación en Aranzadi LA LEY)

No, en absoluto. Sí creo que son herramientas que sin duda van a utilizar todos los operadores jurídicos: abogacía, fiscalía, asesorías jurídicas de empresas, judicatura, etc. Pero las utilizarán supervisándolas, corrigiéndolas, haciéndolas suyas según su experiencia, intuición, compromisos éticos o deontológicos, conocimientos especializados… Y quedarán muchas tareas fuera de la IA, tareas que desempeñan todos ellos y que, o bien una máquina no puede hacer mejor que un humano, porque requieren cualidades que hoy por hoy son humanas; o bien no se pueden automatizar por completo.

Una cuestión que me resulta muy interesante, a este respecto, es que, si bien es cierto que esta tecnología es generativa, genera siempre en base a lo que conoce previamente. Sin embargo, el Derecho debe adaptarse continuamente a la realidad social del tiempo en que ha de ser aplicada, así lo prevé el artículo 3 de nuestro Código Civil (LA LEY 1/1889). Ello es así porque nuestra sociedad progresa, pero la interpretación acorde a cada nueva realidad debe validarla un juez con conocimientos jurídicos, con respeto al iura novit curia y demás principios generales de nuestro ordenamiento jurídico. En el ámbito de compliance, o en el contractual pasa algo parecido: cambian las normas, los mercados, los productos, los canales, los clientes… La IA generativa ayudará y ahorrará tiempo, esfuerzo y errores, pero la genialidad humana, la idea feliz, el progreso, en definitiva, seguirá viniendo de la validación humana.

Dicho esto, sí creo que podría sustituir a quienes exclusivamente realicen tareas que la máquina pueda hacer mejor y más rápido. Es difícil predecir qué sucederá en el futuro, pero hoy por hoy me resulta evidente que muchas de las tareas de todos los operadores jurídicos son tan complejas y diversas que no pueden ser realizadas por máquinas. Ayudarán mucho, e incluso donde ayuden, será precisa la supervisión humana.

Gerard Espuga Torné (Abogado)

«La IA generativa no debería, en ningún caso, sustituir a Letrados, Jueces o, en general, a los operadores jurídicos. A estos efectos, cobra especial relevancia el concepto de la hermenéutica jurídica, entendida como aquella herramienta que el operador jurídico debe utilizar constantemente en el proceso de toma de decisiones, siendo algo vinculado de manera inexorable a la mente humana. La hermenéutica jurídica, por tanto, permite interpretar textos legales teniendo en cuenta más elementos que el mero texto de la disposición normativa, lo cual no puede ser debidamente realizado por la IA o, cuanto menos, no debería serlo sin la preceptiva intervención humana en el proceso de toma de decisiones.

Así las cosas, la inteligencia artificial generativa no debería sustituir a los operadores jurídicos, pero sí podría asistirlos en la realización ciertas tareas sin perjuicio, insisto, de la correspondiente intervención humana, que deberá ser más «robusta» cuanta mayor afectación pueda tener la decisión sobre la persona. En cualquier caso, la posible pérdida de puestos de trabajo enfocados a la realización de tareas más "mecánicas" podría suplirse con la creación de nuevos puestos de trabajo asociados al desarrollo y evolución de este tipo de tecnología, enfocados, en su caso, a comprobar y verificar el legal desarrollo y utilización de estos sistemas.»

Nuria Rando Rando (Abogada en RocaJunyent-Gaona, Palacios y Rozados y Coordinadora de la Sección de Derecho Digital e Innovación en Abogacía de Málaga)

«La posibilidad de que la IA sustituya directamente a abogados, jueces u otros profesionales del sector jurídico es complicada por el momento. No obstante, considero que hay muchas tareas de los profesionales que sí pueden ser sustituidas por la IA Generativa o, que los profesionales se pueden apoyar en este tipo de tecnología para mejorar los servicios que prestan.

Ello no quita que, considere que más pronto que tarde se pueden llegar a destruir bastantes puestos de trabajo en el sector legal ya sea a nivel de profesionales o de personal auxiliar ya que, debido a los avances tecnológicos, pueden existir consultas o trámites, reclamaciones o ciertas tareas que pueden ser resueltos directamente por la IA Generativa en lugar de por humanos.

Al mismo tiempo y sin que nos ahogue una visión pesimista, considero se crearán nuevos puestos o se necesitarán nuevas habilidades para convivir con los avances que ya tenemos y los que estarán por venir.»

M.ª Paloma Abad Tejerina (Abogada)

«Pienso que, si bien la inteligencia artificial puede tener un potencial para desempeñar un papel de tareas administrativas o repetitivas o de analizar datos, por tener una gran fuente de información, lo real es que no se puede reemplazar ni a los abogados ni a los jueces ni a ningún otro operador jurídico, mucho menos en un sistema jurídico complejo y controvertido.

Que algo pueda ser útil para investigar y analizar grandes volúmenes de documentos o identificar precedentes legales, no puede, en ningún caso, sustituir el razonamiento humano como en la interpretación de la ley a cada caso concreto, la sensibilidad y atención con consideración a las circunstancias individuales del asunto, así como la comprensión de las necesidades de todas las partes involucradas en un determinado procedimiento.

Considerar la IA como herramienta valiosa sí, pero desde luego no como sustitutiva de los abogados, jueces y demás operadores jurídicos

Considerar la IA como herramienta valiosa sí, pero desde luego no como sustitutiva de los abogados, jueces y demás operadores jurídicos, ya que el componente humano y la toma de decisiones éticas son fundamentales en el sistema legal. Puede ayudarnos a mejorar nuestro trabajo aumentando la eficiencia y la precisión en determinadas áreas, pero en modo alguno sustituirlas".

4º. ¿Qué riesgos comporta el algoritmo en cuanto a la creación de discursos jurídicos? Se conoce el caso de la invención de precedentes jurisprudenciales, pero podrían ser más. ¿Amenaza la I.A Generativa el rigor en la aplicación de la legalidad? ¿Cómo se pueden evitar estos excesos tecnológicos?

Alfonso Peralta Gutiérrez (Juez)

«Como hemos visto, hay casos de jueces y abogados que utilizando ChatGPT han citado legislación o jurisprudencia falsa o inexistente o que a raíz de ello se han dictado resoluciones escandalosas. El propio ChatGPT muestra un disclaimer de que "puede producir información inexacta sobre personas, lugares o hechos", pudiendo crear instrucciones dañosas o contenido sesgado.

Esto parece fruto de un entrenamiento de "pesca de arrastre" con herramientas de webscraping, de manera no selectiva, con ausencia de sujeción a los principios del RGPD de proporcionalidad, pertinencia, adecuación, exactitud o minimización de los datos.

Y ya estamos viendo las consecuencias: ya se habrían interpuesto las primeras demandas contra ChatGPT de OpenAI por vulnerar los datos personales a través de un scraping no autorizado, por difamar a un locutor de radio y por vulneración de propiedad intelectual de New York Times y otros autores y editores por haberse entrenado supuestamente con contenido no autorizado.

Veremos si con ChatGPT no nos encontramos ante el nuevo Napster, Emule, Kazaa o sus clones: una aplicación revolucionaria que contó con millones de usuarios, pero cuyo contenido era de baja calidad, muchas veces inexacto, falso, te infectaba el PC e ilegal. Hasta que unos años después llegó Spotify. No basta con una tecnología revolucionaria, se requiere un modelo de negocio legalmente sostenible.

Y es que desconocemos oficialmente las fuentes de entrenamiento de ChatGPT. Cuando la IA evoluciona de ser un elemento experimental a un producto o servicio, es necesario incorporar las mismas garantías que se le reclaman a cualquier otro producto o servicio. Empresas y administraciones públicas están prohibiendo el uso de la herramienta de OpenAI porque nadie quiere ser responsable del uso de un proveedor externo que no se somete al RGPD, compartir datos personales o confidenciales con una empresa que ha sido apercibida y está siendo investigada por autoridades de control y que los va a utilizar para entrenar el modelo y que parece estar usando a sus usuarios de probadores sin un mínimo de sistema de gestión de calidad

Por último, se hace imprescindible tratar a la IA como herramientas que hay que supervisar su resultado y no como sustitutivos del ser humano en todo caso, evitando el sesgo de sobreestimación.»

Cristina Retana Gil (Directora de Contenidos e Innovación en Aranzadi LA LEY)

Han sido muy comentados los casos de las llamadas «alucinaciones», también en el ámbito jurídico, que tienen lugar cuando esta tecnología genera respuestas convincentes, bien redactadas e incluso lógicas, pero incorrectas, inventadas o directamente falsas, basadas, obviamente, en fuentes de información no fiable. Por eso, como decía antes, son tecnologías con las que hay que trabajar con cautela para poder ofrecer garantías de fiabilidad, privacidad y conocimiento experto. Eso es posible conectando estos modelos con entornos de datos que aseguren que los contenidos están actualizados y son rigurosos, y que los datos de nuestros clientes no van a quedar expuestos.

La precisión y la fiabilidad jurídica de las respuestas de ChatGPT en el ámbito legal, sólo serán válidas y seguras si lo son los conjuntos de datos que se utilicen para entrenar los algoritmos de Inteligencia artificial generativa y se hacen en una infraestructura y entorno securizado que proteja la confidencialidad de los datos.

Este es el camino que estamos siguiendo en Aranzadi LA LEY y en el que creemos firmemente. Nuestra gran base de conocimiento constantemente actualizada será la piedra angular en el uso de inteligencia artificial generativa, y lo que nos va a permitir acelerar el desarrollo de nuevas soluciones de vanguardia y plataformas y servicios personalizados que van a sorprender sin duda al mercado y van a contribuir a transformar de una manera decisiva la forma de operar de los profesionales jurídicos.

Gerard Espuga Torné (Abogado)

«El uso de IA generativa en el ámbito jurídico debe desarrollarse teniendo en cuenta todas las cautelas posibles, pues pueden ponerse en riesgo derechos fundamentales de las personas. Lo que puede ser visto como una oportunidad para los profesionales jurídicos puede convertirse en una fuente de responsabilidad para los mismos. Para evitarlo, es fundamental la supervisión humana de estos sistemas durante todo el ciclo de vida de los mismos.

A estos efectos, la Propuesta de Reglamento de Inteligencia Artificial establece la supervisión humana como elemento fundamental de los sistemas de IA de alto riesgo (p.e. identificación biométrica en espacios públicos, en el ámbito educativo para determinar la admisión de personas a centros educativos o para evaluar resultados, o en el ámbito laboral, para determinar promociones o en la contratación de personas o, también, en asuntos relacionados con la aplicación de la Ley).

Como decimos, la supervisión humana debe ser vista como parte integral del sistema, tanto en fase de desarrollo, como en fase de uso. Así, los sistemas de IA de alto riesgo deben diseñarse y desarrollarse de manera que las personas físicas puedan supervisar su marcha, por lo que el proveedor del servicio debe identificar las medidas apropiadas de supervisión humana antes de la puesta a disposición en el mercado (artículos 13, 14, 16 y 29 Propuesta Reglamento IA). Es fundamental, a estos efectos, la correcta aplicación del artículo 22 del RGPD (LA LEY 6637/2016), que prohíbe, salvo excepciones y determinadas garantías, la toma de decisiones automatizadas con efectos jurídicos o significativamente similares sobre las personas físicas.

En el borrador del Parlamento Europeo del proyecto de Reglamento de IA se incluyó un nuevo artículo, el 68 c,) referente a la toma de decisiones individuales por sistemas de IA.

Este artículo debería, en su caso, aplicarse sin perjuicio de lo establecido en el art. 22 RGPD (LA LEY 6637/2016), cuando se trate de sistemas de IA de alto riesgo que produzcan efectos legales o impacten significativamente de manera negativa a la salud, seguridad, derechos fundamentales, bienestar socioeconómico o cualquier otro de los derechos derivados de las obligaciones previstas en el Reglamento.

A diferencia del art. 22 que, en principio, está previsto tanto para decisiones automatizadas (con efectos jurídicos o similares) que afecten positiva o negativamente, el derecho previsto en el art. 68 c) del Reglamento IA, está previsto solo cuando las consecuencias sean negativas, en cuyo caso se podrá solicitar una explicación clara y sencilla sobre el proceso de toma de decisiones y los datos de entrada a quien usó dicho sistema de IA.

En cualquier caso, dónde no llegue el Reglamento de IA deberá llegar el RGPD.»

Nuria Rando Rando (Abogada en RocaJunyent-Gaona, Palacios y Rozados y Coordinadora de la Sección de Derecho Digital e Innovación en Abogacía de Málaga)

«Sin duda, la IA Generativa debe seguir mejorando y se deben corregir desviaciones como la planteada en la que la IA da respuestas sobre precedentes inexistentes. Que la IA Generativa tenga muchos usos o posibles funcionalidades que pueden mejorar las profesiones jurídicas no quiere decir que no tengamos que ser cautelosos y responsables en su uso ya que, de lo contrario podemos encontrarnos en escenarios de potenciales riesgos. La IA necesita entrenamiento controlado y supervisión humana del mismo modo que, las respuestas que nos ofrezca deberíamos confirmarlas con otras fuentes tradicionales (bases de datos de sentencias, normas vigentes, boletines oficiales, el propio documento analizado, etc.).

En el momento en el que estamos, no considero que la IA Generativa pueda ser una amenaza para el rigor en la aplicación de la legalidad siempre y cuando, como ya se ha advertido, se use de forma controlada y consciente y, se corrijan los errores que se vayan detectando. Considero que podría llegar a ser un riesgo si es usada de forma no consciente o descontrolada por parte de legos en derecho y dando total fiabilidad a las respuestas o documentos generados por la IA.

Precisamente, para evitar excesos tecnológicos que ya vienen ocurriendo y corregir las desviaciones y efectos negativos de la IA ante usos inadecuados, tanto la UE como España vienen promulgando instrumentos normativos que obligan a dar transparencia los algoritmos y datos con los que se entrena la IA, exigir que se cumpla con principios éticos y que se controle conscientemente la misma.»

M.ª Paloma Abad Tejerina (Abogada)

«Pienso que la utilización de la IA en la creación de discursos o argumentos jurídicos puede plantear muchos riesgos sobre todo en la aplicación rigorista de la legalidad.

Hoy por ello:

- a) Se pueden utilizar precedentes jurídicos incorrectos (y por ello la labor personal del abogado es de gran importancia). Además, que disponga de datos no significa que todos sean fuentes fidedignas, y pueden ser incorrectas con lo cual el jurista debe verificar.

- b) Interpretaciones legales inapropiadas.

- c) Falta de ética en las respuestas.

Por todo ello se hará necesario la revisión del jurista que solicite o que haya hecho la consulta para que cumpla todos los requisitos de calidad, ética y moderación necesarios, así como adaptación al caso concreto.»

5º. Existe cierta preocupación en el sector legal tras la irrupción de estas tecnologías. ¿Qué podemos esperar de los próximos meses? ¿Y de los próximos años? ¿Qué horizonte tiene por delante la I.A generativa en el marco jurídico?

Alfonso Peralta Gutiérrez (Juez)

«El salto cualitativo será cuando estos sistemas se entrenen con datos específicos y mucho más seleccionados como la base de datos de LA LEY, el CENDOJ y tu propio disco duro con el historial de casos que has llevado, y sepas, que no sólo hay muchos datos, sino que estos son fiables y hay un mínimo riesgo de inexactitudes, errores o "alucinaciones", y cumpla criterios de explicabilidad, auditabilidad, trazabilidad y transparencia con sistemas de gestión de calidad. O cuando una empresa o un despacho utilice sus bases de datos para entrenar su propio sistema.

Si bien está claro que el software o la inteligencia artificial perfecta no existen (al igual que tampoco el riesgo cero), sin embargo, incrementar la tasa de éxito y una serie de medidas de diseño, evaluación y rendición de cuentas, supondría una importante diferencia. Al igual que a las industrias de aviación, locomoción, arquitectura o ingeniería les exigimos que la tasa de accidentes por fallo del vehículo, del avión o de demoliciones por ruina sean casi testimoniales. De la misma manera se le debía exigir a otro sector de riesgo como es la IA. Y al igual que estas industrias deben cumplir las legislaciones, diseñar los proyectos, obtener certificaciones y cumplir pruebas de seguridad, investigar los accidentes y responder por los daños causados a las víctimas, de la misma manera deberá hacerlo la industria del software y la IA.»

Cristina Retana Gil (Directora de Contenidos e Innovación en Aranzadi LA LEY)

Considero que vivimos un momento apasionante, también para el sector jurídico. Estas nuevas herramientas son un reto y un desafío, y por lo tanto, una oportunidad. Reto y desafío que en Aranzadi LA LEY vivimos con enorme ilusión, coincidiendo con nuestra integración en el grupo Karnov, al que recientemente nos hemos incorporado, y que comparte esta visión, apostando fuerte por esta nueva era, con una importante partida económica asignada a la innovación en general, y a la inteligencia artificial generativa en particular. En las próximas semanas y, de forma continuada, vamos a poder compartir con nuestros clientes proyectos interesantísimos en los que estamos trabajando, algunos ya accesibles por algunos de nuestros usuarios.

Gerard Espuga Torné (Abogado)

«La IA tiene el potencial, no tan lejano, de modificar la forma en que se prestan servicios en general, y el sector jurídico no estará exento de esos cambios. Como se ha dicho, si bien puede ofrecer beneficios, no es menos cierto que también genera preocupaciones desde la óptica regulatoria y desde lo que se ha llamado la «ética de la inteligencia artificial.

Esa ética tiene mucho que ver con el desarrollo del sistema en una fase temprana y con el seguimiento que de los modelos se realice durante su ciclo de vida. A estos efectos, debe prestarse especial atención a los sesgos que puedan tener los sistemas de IA, que se producen al introducir los datos de entrenamiento de los sistemas y en el diseño de los mismos, lo que puede conllevar a un trato desfavorable para ciertos grupos de personas o individuos, por lo que, siendo la no discriminación un principio básico que rige nuestro ordenamiento jurídico, debe evitarse.

Es ahí, en la detección de estos sesgos, donde los operadores jurídicos pueden tener un papel relevante, sobre todo por lo que se refiere a los sesgos "humanos" y "sistémicos".

Es posible que en un futuro no tan lejano no pueda distinguirse el contenido creado con IA del que es real y la posibilidad de crear contenido estará, irremediablemente, al alcance de cualquiera

Asimismo, es posible que en un futuro no tan lejano no pueda distinguirse el contenido creado con IA del que es real y la posibilidad de crear contenido estará, irremediablemente, al alcance de cualquiera. Como se ha podido ver ya (entre otros, en el caso "Almendralejo") la IA se puede convertir en una nueva herramienta para cometer hechos delictivos, igual que lo fueron en su día las redes sociales o, en general, internet, en aras a ese supuesto anonimato que confiere la red. No conviene, debe decirse, caer en el equívoco de intentar prohibir cierta tecnología sino estar prevenidos para aquellos usos ilícitos que de la misma puedan realizarse y, por tanto, prepararse técnica y jurídicamente para ello.

Así las cosas, si bien el futuro Reglamento de IA será bienvenido para regular ciertos usos de IA con un mayor riesgo intrínseco, no debemos olvidar que tenemos a nuestro abasto normativa para atajar, desde ya, conductas o usos ilícitos de estos sistemas de IA.»

Nuria Rando Rando (Abogada en RocaJunyent-Gaona, Palacios y Rozados y Coordinadora de la Sección de Derecho Digital e Innovación en Abogacía de Málaga)

«La preocupación es patente pero el lanzamiento de herramientas o proyectos con IA Generativa relacionados con el sector legal cada poco meses también lo es. Grandes editoriales o despachos de abogados ya han lanzado sus herramientas dedicadas al sector legal y que se basan en IA Generativa y, en el corto plazo, seguiremos viendo nuevos lanzamientos.

Aunque sigue existiendo cierta resistencia del sector legal en el uso de IA, pienso que poco a poco se va a ir introduciendo trabajo diario de los profesionales del derecho ya sea porque se usan integrados en los programas de gestión o bases de datos que se tengan en los propios despachos o porque se vayan adquiriendo ciertas licencias para usos concretos; ya indicaba anteriormente que la IA Generativa para mejorar la atención al cliente puede ser una gran aliada y no tengo dudas que pronto se empezará a explotar esa parcela del sector legal.

Indudablemente, los programas de gestión y las bases de datos también van a dar mucho que hablar en cuanto a IA Generativa ya que en el análisis de jurisprudencia y normas e incluso en resoluciones judiciales que sean notificadas a los abogados o procuradores, la IA tiene gran potencial.»

M.ª Paloma Abad Tejerina (Abogada)

«Como todas las innovaciones que han ido sucediendo en el desarrollo de la vida humana, plantean nuevos retos y desafíos, y también preocupaciones y por supuesto oportunidades.

En los próximos tiempos vamos a poder esperar una mayor adopción de estas tecnologías para tareas como la revisión de documentos legales o automatización de procesos rutinarios. Y a medida que avancen los años, cuando vayan teniendo cada vez más datos los sistemas de IA, pues es probable que continúe mejorando sus términos de precisión y capacidad para generar documentos legales cada vez más complejos, aunque nunca sustitutorios de la actividad personal y profesional de los operadores jurídicos que intervienen.

A mi modo de ver, lo más importante es que se plantean desafíos éticos y también legales en cuanto a la responsabilidad de los resultados generados por la IA, la privacidad de los datos, y la necesidad de regulaciones claras. Por lo tanto el horizonte a más largo plazo de la IA dependerá en gran medida de cómo se aborden todos los desafíos que en estos momentos tenemos sobre la mesa: el desarrollo y aportación de datos a la IA, la propia evolución legislativa judicial y jurisprudencial de cada uno de los países, y también la evolución de la tecnología.

La IA ha venido, y ha venido para quedarse, por lo que negarla o proscribirla nos aleja del avance Deberíamos estudiar con rigor sus retos, sus peligros, establecer su uso, sus normas éticas, legales, para tener normas seguras en las que apoyarnos, ello cuanto más pronto mejor, porque siempre los inicios, como en el presente momento, desconociendo realmente cómo funciona, sin saber los límites, son inseguros para muchos y muy aprovechados por otros.

Así pues. el horizonte a largo plazo dependerá en gran medida de cómo se aborden estos desafíos y de la evolución tecnológica y de la legislación.»

6º. Las aplicaciones de Inteligencia Artificial requieren de una importantísima cantidad de datos. ¿La regulación europea y nacional es actualmente eficaz para proteger los datos personales frente a este tipo de operativos? ¿Qué opinión merecen los trabajos llevados hasta ahora por la Unión Europea en cuanto a la regulación de la I.A? ¿Podemos ser optimistas?

Alfonso Peralta Gutiérrez (Juez)

«Se han cumplido cinco años del RGPD y nos encontramos al inicio de la estrategia digital europea (2030 Digital Compass). Se pretende una transformación digital de las empresas, aumento de la tecnología o duplicar los «unicornios» de la UE. Y para ello se apoya en un mercado único digital interconectado, interoperable y seguro y en una estrategia digital normativa y de policy enorme: reglamentos europeos relativos a datos, ciberseguridad, privacidad, inteligencia artificial, servicios digitales, mercados digitales, identidad digital, o chips. Todo ello además financiado con fondos europeos Next Generation, buscando una soberanía digital, no depender de datos y empresas tecnológicas americanas y chinas y proteger a los consumidores respecto a la propiedad de sus datos. En el caso por ejemplo de las Administraciones Públicas cobran una especial relevancia que sus datos se alojen en centros de datos nacionales o al menos europeos y sujetos a normativa europea. Veremos si esta estrategia revierte la situación actual donde un 92% de los datos del mundo occidental estarían en manos norteamericanas frente al 4% europeo y además crea un «efecto Bruselas» con una IA que respete los derechos humanos y valores europeos.

Yo particularmente, no veo demasiado un liderazgo empresarial en sus ámbitos definiendo una política y unos objetivos acordes a todas esas exigencias éticas y normativas de las que tanto se habla con una asignación de recursos necesarios, toma de conciencia, promoción, procesos y mejora continua. En cuanto al Reglamento, su aprobación parece inminente pero su entrada en vigor no será por lo menos hasta 2025, al igual que las normas estandarizadas y el sello español de IA. Será entonces cuando comenzará a verse si las empresas y administraciones públicas se han preparado para su entrada en vigor o están como cuando en los bares británicos tocan la campana anunciando el Happy Hour, la última ronda antes de que llegue el verdadero control, pensando que no pagarán ninguna responsabilidad hasta entonces.»

Foto: Dechert LLP, FASSHAUER Dr. Olaf; KAVANAGH Paul WHITE Madeleine. EU Data and Digital Drive: an Overview of Forthcoming Legislation. 10 de Agosto de 2022. JDSupra.

Cristina Retana Gil (Directora de Contenidos e Innovación en Aranzadi LA LEY)

La Unión Europea está dando pasos de gigante en la regulación de la inteligencia artificial, también de la generativa. En mayo pasado conocimos cómo los comités de trabajo del Parlamento Europeo remitieron al pleno la versión del futuro Reglamento. De ella, destacaría la ampliación de las prácticas de inteligencia artificial que se consideran prohibidas y las consideradas de alto riesgo. También se establecen requisitos más estrictos para los sistemas de IA generativa como ChatGPT y se incorporan medidas para que los ciudadanos puedan presentar quejas sobre los sistemas de IA y puedan recibir explicaciones sobre las decisiones automatizadas que afecten significativamente a sus derechos. Necesitamos una normativa que permita que Europa siga progresando en los mercados mundiales, pero sin que ello suponga un menoscabo para los ciudadanos. Muchos expertos comparan que el resultado del futuro Reglamento supondrá para la IA y para los ciudadanos europeos algo similar a lo que implicó el RGPD. Eso me hace ser optimista. Aprovecho la ocasión para animar a nuestros lectores a seguir todos los avances en la temática en nuestro Diario LA LEY Ciberderecho.

Gerard Espuga Torné (Abogado)

«Las IA generativas se nutren de grandes cantidades de datos para poder entrenar los sistemas para que estos, a su vez, produzcan las «salidas» deseadas. Estos grandes modelos de lenguaje o LLM (Large Language Models), suelen obtener estos datos a través de un barrido de páginas web en internet, mediante la técnica llamada data scraping, lo que plantea importantes problemas de privacidad, puesto que el hecho de que la información sea públicamente accesible no supone que la misma esté exenta de la normativa sobre protección de datos personales y, mucho menos, que pueda utilizarse para una finalidad distinta de la original. Evidentemente, no solo surgen problemas en materia de protección de datos, sino también relacionados con la propiedad intelectual de los contenidos utilizados.

Dicho lo anterior, el RGPD facilita bases de legitimación para el tratamiento de datos personales (art. 6.1 RGPD (LA LEY 6637/2016)). Que sea complicado obtener la base adecuada no significa que no exista, por lo que debe buscarse la base de legitimación idónea para cada operación de tratamiento.

Igualmente, es importante que el tratamiento que se realice en las siguientes fases del ciclo de vida del modelo, entre estas, desarrollo y uso, cuente con una base de legitimación lícita que, en su caso, podrá ser diferente de la utilizada en fase de entrenamiento.

Especial relevancia cobrará, en caso de que se tomen decisiones individuales automatizadas con efectos jurídicos o similares sobre las personas, la intervención humana y la explicabilidad de la decisión en cuestión, de conformidad con lo establecido en el art. 22 RGPD (LA LEY 6637/2016). A estos efectos, la propuesta de reglamento de IA establece la obligación, para proveedores de sistemas de alto riesgo, de diseñar sistemas que permitan la intervención humana, así como la de realizar las correspondientes evaluaciones de riesgo ex ante. Así, los usuarios de los sistemas deberán seguir una suerte de "manual" establecido por el proveedor respecto a la supervisión humana, criterios que, finalmente, deberán ser determinados por el proveedor sin que el Reglamento detalle, por el momento, cómo deben ser.

Como vemos, la convergencia y «simbiosis» entre el RGPD y el futuro Reglamento de IA será fundamental, así como lo será definir cómo y desde dónde se produce la indicada intervención humana como eje fundamental para garantizar la explicabilidad de las decisiones tomadas mediante estos sistemas.»

Nuria Rando Rando (Abogada en RocaJunyent-Gaona, Palacios y Rozados y Coordinadora de la Sección de Derecho Digital e Innovación en Abogacía de Málaga)

«En mi opinión, la normativa de protección de datos tanto a nivel nacional como comunitario es eficaz para proteger los datos personales en los entrenamientos de la IA ya que cuenta con principios, deberes y obligaciones muy claros. Ahora bien, una cuestión es que la norma sea eficaz y otra que sea cumplida por los operadores jurídicos o que, en caso de incumplimiento, existan los recursos públicos suficientes para vigilar el cumplimiento de la norma y sancionar a los infractores. En no pocas ocasiones, la gran cantidad de datos que son necesarios para entrenar a una IA hace inoperativa la solicitud del consentimiento del interesado para el tratamiento por lo que, es frecuente que los datos con los que se entrena la IA sean anonimizados, ahora bien, se debe demostrar que dicha anonimización es efectiva y no existe riesgo de reidentificación del sujeto.

No obstante, la tecnología avanza a una velocidad que la norma no llega a alcanzar y, por tanto, es posible que en ocasiones existan vacíos normativos para cuestiones concretas. A nivel general en protección de datos personales considero muy acertadas las corrientes teóricas que ponen en el centro de las decisiones y control sobre los propios datos a los interesados en contraposición del sistema basado en que el responsable solicita el consentimiento del interesado y con ello es el responsable quién controla los datos.

Por último, en cuanto a la regulación de la UE sobre la IA no cabe duda que ha sido y está siendo bastante lenta. Desde que se publicó el Libro Blanco de la IA hasta que se aprobó el pasado mes de junio la Ley Europea de IA han pasado casi 4 años. Al igual que lo manifestado en párrafos anteriores en cuanto a la protección de datos de carácter personal, la normativa de IA va encaminada a garantizar condiciones óptimas de desarrollo y uso de esta tecnología, pero, lo primordial a mi parecer es que se cuide y vigile el desarrollo adecuado y se incorporen mecanismos para evitar sesgos discriminatorios, ilegales y no éticos de la IA.

Podemos ser optimistas, pero a la velocidad a la que avanza la tecnología y la lentitud en la implementación de los sistemas de control, indudablemente nos va a llevar a que seamos testigos de episodios dañinos creados a través de IA como el último caso de los menores de Almendralejo.»

M.ª Paloma Abad Tejerina (Abogada)

«La Unión Europea ha adoptado el Reglamento de Protección de Datos que establece reglas sólidas para proteger los datos personales, pero su interpretación, también depende de los países de la UE; algunos más restrictivos que otros.

La Comisión Europea ha propuesto también un Reglamento de IA, en la idea de abordar cuestiones éticas y legales. Pienso que el trasfondo debe basarse en centrarse en la transparencia, la responsabilidad, la evaluación de los riesgos, la Protección de Datos, los derechos individuales, y entre ellos la responsabilidad por la inadecuada utilización de la IA,

Soy optimista en su desarrollo, su normativización e implantación.»